جدیدترین مطالب

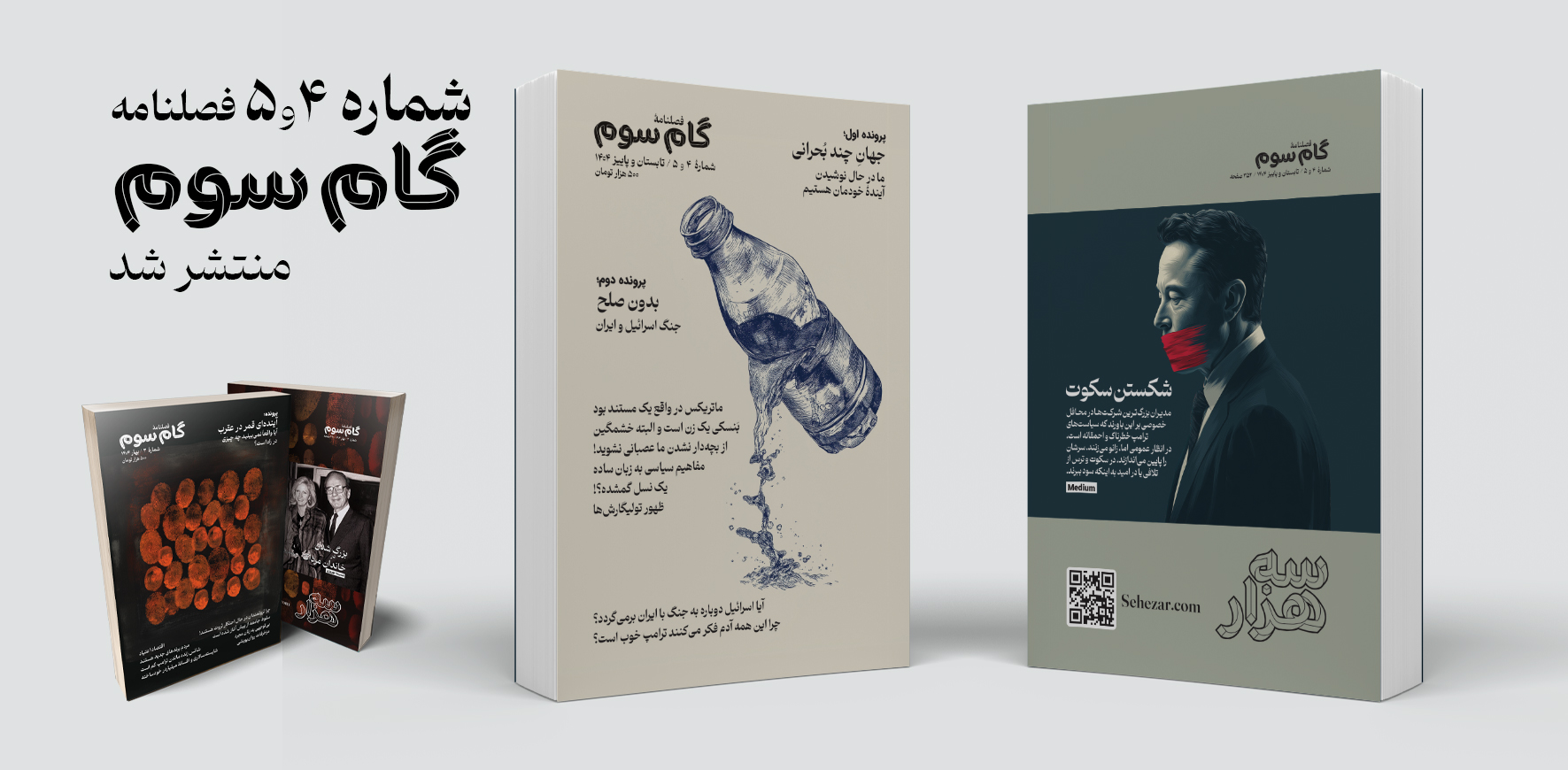

فصلنامه «گام سوم» شماره ۴ و ۵

در این نوبت از فصلنامه گام سوم دو شماره «۴ تابستان» و «۵ پاییز» بهطور همزمان منتشر شده است که همچون شمارههای پیشین شامل مقالات متنوعی در موضوعات اقتصاد، آینده مشاغل، خانواده، نوشتار و سیاست به همراه دو پرونده با موضوعات داغ روز میشود.

۱۳ رفتار غیرمعمول مدیران موفق که شاید شما را شگفتزده کند!

ادارهی یک شرکت کاری پر استرس است، بهویژه اگر یکی از بزرگترین شرکتهای جهان را مدیریت کنید. این میزان بالای استرس میتواند به عادتهای روزانهی شدید و غیرمعمول منجر شود. در ادامه، برخی از عجیبترین روالهای روزانهی مدیرعاملها آمده است.

چرا نترسیدن شرط یافتن پاسخهای مهم است؟

فهمیدم سلامت روانم بهتر شده است، وقتی به خارج از کشور رفتم و دیگر دچار شوک فرهنگی نشدم.من بخش زیادی از خودم را در دخترانم میبینم. آنها مشتاقاند وظایفشان را درست انجام دهند و اگر احساس کنند چیزی ممکن است «نامناسب» به نظر برسد، ناراحت و آشفته میشوند.

داستان های علمی تخیلی؛ پلی میان تخیل و ارتباط علمی مؤثر

وقتی وارد دوره دکترایم شدم، میدانستم به همان اندازه که از انجام پژوهش لذت میبرم، عاشق انتقال علم به عموم مردم نیز هستم. اما خیلی زود پژوهش بیشتر وقت مرا بلعید. اغلب تا نیمههای شب کار میکردم و بیشتر آخر هفتههایم صرف آمادهسازی آزمایشها، گردآوری دادهها یا جبران عقبماندگی از انبوه پایانناپذیر مقالات علمی روی میزم میشد.

پربازدیدترین مطالب

ابتکار جهانی در امنیت غذایی با کمک فناوری و نوآوری

این ابتکار توسط مجمع جهانی اقتصاد و با حمایت گروهی متنوع از سازمانها از جمله دولت هلند، ابتکارات جهانی محمد بن راشد آل مکتوم، امارات متحده عربی و بنیاد بیل و ملیندا گیتس به پیش رانده شده است.

جهان خسته از نابرابری و ثروتمندان

با تشدید بحرانهای محیطزیستی، اجتماعی و انسانی، جهان دیگر قادر به تحمل دو چیز نیست: ۱- هزینههای نابرابری اقتصادی ۲- جامعه ثروتمندان. کاهش نابرابری اقتصادی بهتنهایی درمانی برای این بحرانهای جهانی نیست، اما نقش محوری در حل همه آنها دارد.

روند ۱۰۰ ساله تغییر اشتغال زنان به روایت تصویر

نگاهی به تصاویر صد سال گذشته نشان میدهد که زنان چگونه از جنگهای جهانی تا قرن ۲۱، توانستند مرزهای شغلی را جابهجا کنند و مسیر جدیدی در تاریخ نیروی کار رقم بزنند.

نویسنده: رومان چودری مترجم: آناهیتا پاشاه ۱۴ مهر ۱۴۰۳

سافتفیکها: ترفند جدید کمپینهای سیاسی

در سال انتخابات، هوش مصنوعی با «سافتفیکها»[1] نامزدها را بامزهتر از واقعیت نشان میدهد، در حالی که قوانین نظارت بر این دستکاریها هنوز وجود ندارد. این مقاله به بررسی چالشهای اخلاقی و نیاز فوری به قوانین جدید میپردازد. اگر به نقش هوش مصنوعی در انتخابات علاقهمندید، این مقاله را بخوانید!

این مطلب نوشتهای است از رومان چودری که در تاریخ ۹ آوریل ۲۰۲۴ با عنوان

?AI-fuelled election campaigns are here — where are the rules

در وبسایت Nature منتشر شده است. ترجمه این مطلب توسط آناهیتا پاشاه انجام شده و در اختیار خوانندگان گرامی قرار میگیرد.

از جمعیت نزدیک به دو میلیارد نفری که امسال در کشورشان انتخابات برگزار میکنند، برخی از آنها قبلاً رأی خود را دادهاند. انتخابات اندونزی و پاکستان که در ماه فوریه برگزار شده، به همراه کشورهای دیگر، نمایی اولیه از آنچه در پیش است را ارائه میدهند، زیرا فناوریهای هوش مصنوعی به طور پیوسته به عرصه انتخاباتی نفوذ میکنند. این تصویر نوظهور بسیار نگرانکننده است و نگرانیها بسیار فراتر از صرفاً اطلاعات نادرست یا تکثیر اخبار جعلی هستند.

به عنوان مدیر سابق تیم یادگیری ماشین، اخلاق، شفافیت و پاسخگویی (META) در توییتر (قبل از تبدیل شدن به ایکس)، میتوانم به تلاشهای گسترده مداوم برای شناسایی و متوقف کردن اطلاعات نادرست مرتبط با انتخابات که توسط هوش مصنوعی مولد (GAI) ممکن میشود، گواهی دهم. اما استفاده از هوش مصنوعی توسط سیاستمداران و احزاب سیاسی برای اهدافی که آشکارا مخرب نیستند، نیز نگرانیهای عمیق اخلاقی را به همراه دارد.

هوش مصنوعی مولد (GAI) عصری از «سافتفیکها» را آغاز کرده است. اینها تصاویر، ویدئوها یا کلیپهای صوتی هستند که دستکاری شدهاند تا یک نامزد سیاسی را جذابتر نشان دهند. در حالی که دیپفیکها (رسانههای تصویری دیجیتالی دستکاری شده) و چیپفیکها (رسانههای تغییر یافته با کیفیت پایین) با عوامل مخرب مرتبط هستند، سافتفیکها اغلب توسط تیم کمپین خود نامزد ساخته میشوند.

برای مثال، در انتخابات ریاست جمهوری اندونزی، نامزد برنده پرابوو سوبیانتو به شدت به هوش مصنوعی مولد (GAI) متکی بود و با ایجاد و تبلیغ آواتارهای کارتونی خود را به عنوان "gemoy" (که به معنی «بامزه و دوستداشتنی» است) معرفی نمود. این تغییر ظاهر به کمک هوش مصنوعی بخشی از تلاش گستردهتری برای جذب رأیدهندگان جوان و حذف اتهامات مربوط به نقض حقوق بشر در دوران خدمتش به عنوان یک افسر ارشد ارتش بود. بیبیسی او را «پدربزرگ بامزه اندونزی با گذشتهای خونین» نامید.

علاوه بر این، استفاده هوشمندانه از دیپفیکها، از جمله بازآفرینی مجازی رئیسجمهور مرحوم اندونزی، سوهارتو، به وسیله هوش مصنوعی توسط گروهی که از سوبیانتو حمایت میکردند، به گفته برخی ممکن است به پیروزی شگفتانگیز او کمک کرده باشد.

نگهات داد، بنیانگذار سازمان پژوهشی و حقوقی بنیاد حقوق دیجیتال مستقر در لاهور، پاکستان، مستند کرده است که چگونه نامزدهای انتخابات در بنگلادش و پاکستان از هوش مصنوعی مولد (GAI) در کمپینهای خود استفاده کردند، از جمله مقالات نوشته شده توسط هوش مصنوعی که تحت نام نامزد منتشر میشد. انتخابات در جنوب و جنوب شرق آسیا مملو از ویدئوهای دیپفیک از نامزدها بوده است که به زبانهای مختلف صحبت میکنند، آهنگهای نوستالژیک میخوانند و ... که آنها را به شکلی انساننما به تصویر میکشد که خود نامزدها در واقعیت نمیتوانستند انجام دهند.

چه باید کرد؟ میتوان دستورالعملهای جهانی در مورد استفاده مناسب از هوش مصنوعی مولد (GAI) در انتخابات در نظر گرفت، اما این دستورالعملها باید چه باشند؟ تاکنون برخی تلاشها صورت گرفته است. به عنوان مثال، کمیسیون ارتباطات فدرال ایالات متحده استفاده از صداهای تولید شده توسط هوش مصنوعی در تماسهای تلفنی، معروف به تماسهای رباتی (robocalls)، را ممنوع کرده است. شرکتهایی مانند متا، واترمارکهایی [یک برچسب یا کد تعبیه شده در یک تصویر یا ویدئو] برای علامتگذاری رسانههای دستکاری شده راهاندازی کردهاند.

اما اینها اقدامات کلی و اغلب داوطلبانه هستند. قوانین باید در طول کل زنجیره ارتباطات از شرکتهایی که محتوای هوش مصنوعی تولید میکنند تا پلتفرمهای رسانههای اجتماعی که آنها را توزیع میکنند، وضع شوند.

شرکتهای تولید محتوا باید به دقت نحوه استفاده از واترمارکها را تعریف کنند. واترمارکها میتوانند به صورت واضح مانند یک مهر باشند، یا به صورت پیچیدهتر مانند متادیتای تعبیهشده که توسط توزیعکنندگان محتوا شناسایی شود.

شرکتهایی که محتوا توزیع میکنند باید سیستمها و منابعی برای نظارت نه تنها بر اطلاعات نادرست، بلکه همچنین بر سافتفیکهای بیثباتکننده انتخابات که از طریق کانالهای رسمی و تأیید شده توسط نامزدها منتشر میشوند، به کار بگیرند. وقتی نامزدها به واترمارکگذاری پایبند نیستند [هیچیک از این رویهها هنوز اجباری نیستند] شرکتهای رسانههای اجتماعی میتوانند این محتواها را علامتگذاری کرده و هشدارهای مناسب به بینندگان ارائه دهند. رسانهها میتوانند و باید سیاستهای واضحی درباره سافتفیکها داشته باشند. برای مثال، ممکن است یک دیپفیک که در آن سخنرانی پیروزی به زبانهای مختلف ترجمه شده است را بپذیرند، اما دیپفیکهایی که سیاستمداران فقید را در حال حمایت از نامزدها نشان میدهند، رد کنند.

نهادهای نظارتی انتخابات و دولتها باید به دقت افزایش شرکتهایی که در توسعه رسانههای جعلی فعالیت میکنند را بررسی کنند. نرمافزارهای تبدیل متن به گفتار و تقلید صدا از شرکت Eleven Labs، یک شرکت هوش مصنوعی مستقر در نیویورک، برای ایجاد تماسهای رباتی استفاده شد که تلاش داشتند رأیدهندگان را از رأی دادن به رئیسجمهور ایالات متحده، جو بایدن، در انتخابات مقدماتی نیوهمپشایر در ژانویه منصرف کنند و همچنین برای ایجاد سافتفیکهای نخستوزیر سابق پاکستان، عمران خان، در طول کمپین انتخاباتی سال ۲۰۲۴ او از زندان استفاده شد. به جای تصویب قوانین مربوط به سافتفیکها برای شرکتها که میتواند استفادههای مجاز مانند طنز را محدود کند، من پیشنهاد میکنم استانداردهای انتخاباتی در مورد استفاده از هوش مصنوعی مولد (GAI) ایجاد شود. سابقه طولانی از قوانینی وجود دارد که محدود میکنند که نامزدها چه زمانی، چگونه و کجا میتوانند کمپین ایجاد نمایند و مجاز به گفتن چه چیزهایی هستند.

شهروندان نیز نقشی در این زمینه دارند. همه ما میدانیم که نمیتوان به هر چیزی که در اینترنت میخوانیم اعتماد کرد. اکنون، ما باید توانایی تشخیص رسانههای دستکاری شده را توسعه دهیم و همچنین از تمایل احساسی برای فکر کردن به اینکه سافتفیکهای نامزدها «خندهدار» یا «بامزه» هستند، خودداری کنیم. هدف از این کارها دروغ گفتن به شما نیست. آنها اغلب به وضوح توسط هوش مصنوعی تولید شدهاند. هدف این است که نامزد را دوستداشتنی جلوه دهند.

سافتفیکها هماکنون در حال تأثیرگذاری بر انتخابات در برخی از بزرگترین دموکراسیهای جهان هستند. عاقلانه است که ما نیز بیاموزیم و سازگار شویم، زیرا در سال جاری، دموکراسی با حدود ۷۰ انتخابات در چند ماه آینده پیش خواهد رفت.

درباره نویسنده:

رمان چودری، فرستاده علمی ایالات متحده برای هوش مصنوعی است که در واشنگتن دیسی مستقر است.

[1] سافتفیکها رسانههای تصویری، ویدئویی یا صوتی دستکاری شدهای هستند که با استفاده از هوش مصنوعی تولید میشوند تا یک نامزد سیاسی را جذابتر نشان دهند، بدون اینکه لزوماً اطلاعات نادرست ارائه دهند. هدف اصلی سافتفیکها ایجاد احساسات مثبت و دوستداشتنی نسبت به نامزد است.